Der EU AI Act in der Schule

Vom Hype zur Haftung – Wie Schulleitungen jetzt die Weichen stellen

Der „Artificial Intelligence Act“ (AIA) der Europäischen Union ist kein abstraktes Regelwerk für Tech-Giganten im Silicon Valley. Seit seinem Inkrafttreten am 1. August 2024 ist er die neue Leitplanke für jedes Klassenzimmer und jedes Lehrerzimmer in Europa. Während viele Schulen KI noch als spannendes Experimentierfeld oder lästige Datenschutz-Baustelle betrachten, schafft der AI Act nun Fakten. Wer KI-gestützte Lernplattformen, automatisierte Korrekturhilfen oder Analyse-Tools nutzt, bewegt sich in einem regulierten Raum.

Die zentrale Botschaft für Schulleitungen lautet: KI in der Schule ist machbar, aber sie ist kein Selbstläufer mehr. Es braucht eine „Governance“ – eine Struktur, die sicherstellt, dass Technik den pädagogischen Werten und rechtlichen Normen dient, statt sie zu unterwandern.

Unser Autor: Dr. Björn Mokwinski

Björn ist zertifizierter KI-Manager (IHK) und Teamleiter „Unterrichtsentwicklung mit KI“ an den BBS I Delmenhorst. Er verfügt über langjährige Erfahrung in der schulischen Digitalisierung und im KI-Einsatz. Im Team der der Schulstrategen ist er verantwortlich für Fortbildungen zu den Themen KI, Unterrichtsentwicklung an der BBS und Evaluation von Medienkompetenzen.

Die Uhr tickt: Der Stufenplan bis 2027

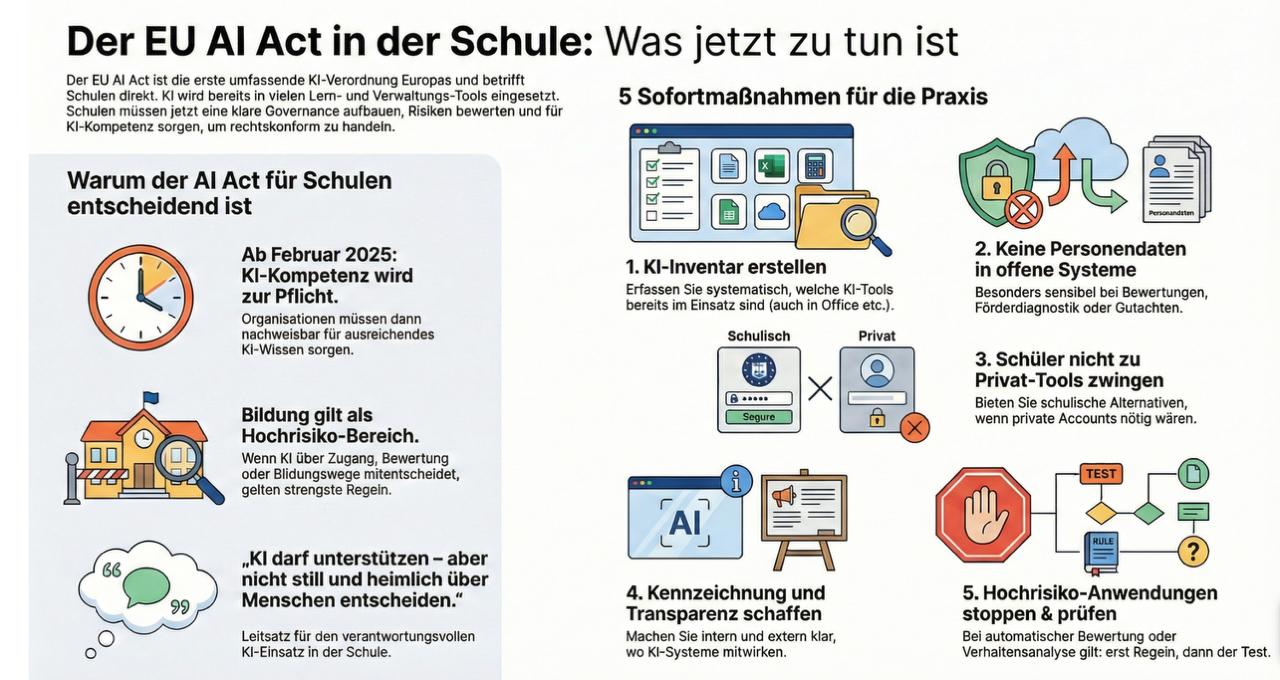

Der Gesetzgeber lässt uns Zeit, aber nicht unbegrenzt. Der AI Act wird gestaffelt wirksam, und der erste wichtige Meilenstein liegt bereits in greifbarer Nähe. Ab dem 2. Februar 2025 greifen die ersten Verbote. Systeme, die das Verhalten von Schülern manipulieren oder deren Emotionen im Unterricht (ohne medizinischen/sicherheitsrelevanten Grund) erfassen, sind ab dann strikt untersagt. Zeitgleich tritt die Pflicht zur Förderung der AI Literacy in Kraft. Das bedeutet: Schulen müssen sicherstellen, dass ihr Personal über die nötige Kompetenz verfügt, KI-Systeme kritisch und sicher zu bedienen.

Im August 2025 folgen strengere Regeln für die Anbieter großer Basismodelle (wie GPT-4), was indirekt die Auswahl der Tools beeinflusst, die wir im Unterricht guten Gewissens zulassen können. Der große „Big Bang“ erfolgt am 2. August 2026. Zu diesem Zeitpunkt wird der Großteil der Verordnung allgemein anwendbar, insbesondere die strengen Anforderungen an Hochrisiko-Systeme, zu denen der Bildungssektor explizit zählt. Bis 2027 schließen sich dann die letzten Lücken für KI-Systeme, die in bereits regulierte Produkte integriert sind. Die Botschaft ist klar: 2025 ist das Jahr der Vorbereitung, 2026 das Jahr der Compliance.

Warum ausgerechnet Bildung? Die Logik des Risikos

Der AI Act basiert auf einer einfachen, aber wirkungsvollen Risikologik. Je massiver eine KI in die Grundrechte und die Lebenswege von Menschen eingreifen kann, desto höher sind die Hürden. Dass Bildung in Annex III der Verordnung als Hochrisiko-Kontext eingestuft wird, ist kein Zufall. Entscheidungen über Noten, Schulaufnahmen oder Förderbedarfe prägen Biografien.

In der Schulpraxis bedeutet das: Ein Tool, das lediglich hilft, ein Arbeitsblatt optisch aufzubereiten, ist unkritisch. Sobald eine KI jedoch individuelle Lernstände analysiert, Notenvorschläge generiert oder gar Prognosen über den künftigen Schulerfolg erstellt, betreten wir die Hochrisiko-Zone. Hier fordert die EU keine Perfektion, aber sie fordert Transparenz, erstklassiges Datenmanagement und – am allerwichtigsten – die menschliche Aufsicht. Eine KI darf in der Schule niemals das letzte Wort über ein Kind haben. Die Lehrkraft muss das System verstehen, seine Fehlerquellen kennen und die Entscheidungshoheit behalten.

Im August 2025 folgen strengere Regeln für die Anbieter großer Basismodelle (wie GPT-4), was indirekt die Auswahl der Tools beeinflusst, die wir im Unterricht guten Gewissens zulassen können. Der große „Big Bang“ erfolgt am 2. August 2026. Zu diesem Zeitpunkt wird der Großteil der Verordnung allgemein anwendbar, insbesondere die strengen Anforderungen an Hochrisiko-Systeme, zu denen der Bildungssektor explizit zählt. Bis 2027 schließen sich dann die letzten Lücken für KI-Systeme, die in bereits regulierte Produkte integriert sind. Die Botschaft ist klar: 2025 ist das Jahr der Vorbereitung, 2026 das Jahr der Compliance.

Von der Theorie zur Praxis: Microsoft Teams als Steuerungszentrale

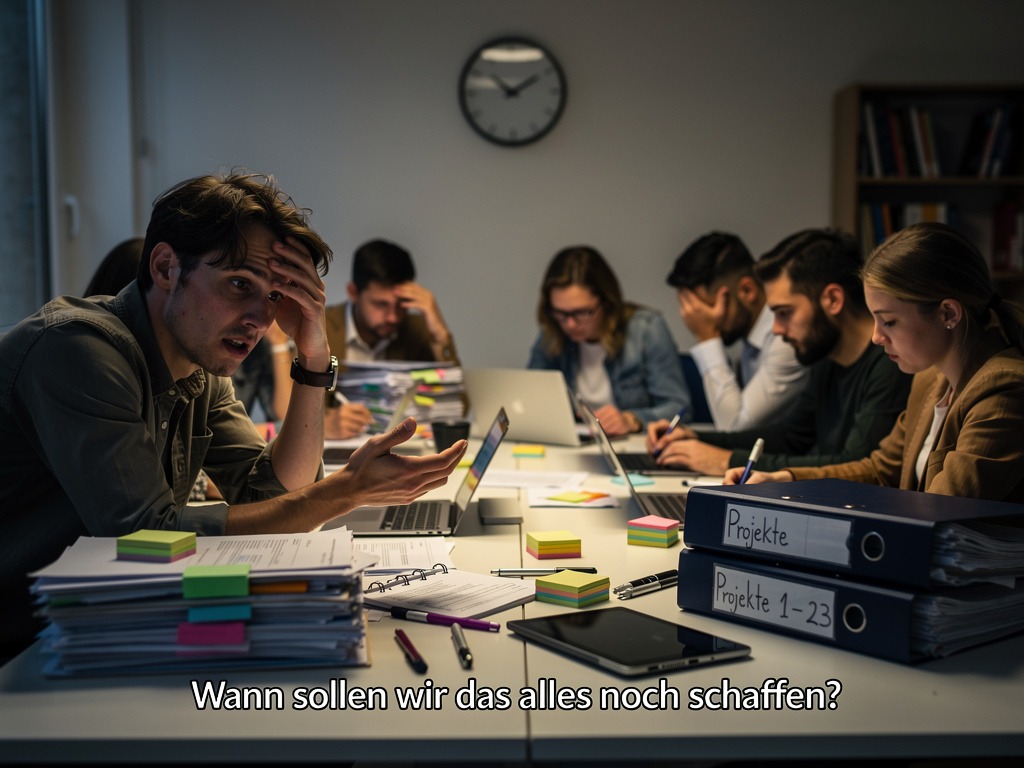

Die größte Hürde für Schulen ist oft nicht der Wille, sondern die Dokumentation. „Wer nutzt eigentlich was?“ ist eine Frage, die viele Schulleitungen ins Schwitzen bringt. Hier kann die ohnehin vorhandene Infrastruktur – wie beispielsweise das LMS – zum Rettungsanker werden. Statt die KI-Nutzung im „Wilden Westen“ des Kollegiums zu belassen, empfiehlt es sich, Teams als zentrale Governance-Plattform zu etablieren.

Ein dediziertes Team „KI-Management“ schafft Ordnung. Durch die Nutzung von Microsoft Lists als Inventarverzeichnis lassen sich alle eingesetzten Tools zentral erfassen und mit einer Risiko-Ampel bewerten. In den Kanälen können Guidelines hinterlegt, Fortbildungsnachweise (AI Literacy) gesammelt und Genehmigungsprozesse über einfache Forms-Formulare abgewickelt werden. So entsteht ein lebendiges Handbuch, das bei einer Überprüfung durch die Schulaufsicht oder den Datenschutzbeauftragten sofort aussagekräftig ist.

AI Literacy: Mehr als nur „Prompting“

Ab Februar 2025 ist KI-Kompetenz keine freiwillige Fortbildung mehr, sondern eine Organisationspflicht. Dabei geht es um weit mehr als die Frage, wie man eine gute Aufgabe formuliert. Echte AI Literacy im Sinne des AI Acts umfasst das Verständnis für die Funktionsweise (und die Grenzen) von LLMs, das Erkennen von Halluzinationen und vor allem die Sensibilität für Biases. Wenn eine KI aufgrund ihrer Trainingsdaten bestimmte soziale Gruppen bei der Bewertung benachteiligt, muss die Lehrkraft in der Lage sein, dies zu erkennen und zu korrigieren. Die Schule muss diesen Kompetenzaufbau strukturiert angehen und – ganz wichtig – dokumentieren.

Antworten